Bun venit la un nou număr din Promptescu Daily Digest!

Astăzi vorbim despre un lucru rar, dar reconfortant: încă mai putem „citi” ce se întâmplă în capul AI-ului… cel puțin pentru moment. OpenAI arată că transparența nu e complet pierdută, iar între timp Waymo apasă frâna și suspendă serviciul de robotaxi în San Francisco, după ce realitatea din teren a bătut simularea.

Promptescu, ce s-a mai întâmplat astăzi în lumea AI?

OpenAI a publicat un studiu care arată că raționamentul de tip chain-of-thought rămâne monitorizabil, dar doar dacă este protejat intenționat.

Waymo a suspendat robotaxiurile din San Francisco după o pană majoră de curent.

Oracle a dezvăluit angajamente cloud în afara bilanțului în valoare de 248 de miliarde de dolari.

Claude Opus 4.5 poate duce la capăt sarcini de până la 5 ore, cel mai mare scor publicat până acum de METR.

OpenAI arată că încă putem „citi” gândirea AI -ului… (deocamdată) 🙃

Când GPT-5 (sau 5.1, sau 5.2, sau orice alt „model care gândește”) rezolvă o problemă, își notează raționamentul pas cu pas înainte de a livra răspunsul final. Asta este util pentru utilizatorii care vor să urmărească logica, dar este și esențial pentru siguranța AI: dacă putem monitoriza ce „gândește” un model, putem identifica problemele înainte să se transforme în acțiuni.

OpenAI tocmai a publicat un studiu care analizează dacă aceste chain-of-thought (CoT) sunt, într-adevăr, de încredere. Întrebarea centrală este simplă: pe măsură ce modelele devin mai capabile, raționamentul lor va rămâne lizibil sau se va transforma într-o cutie neagră criptată?

Ce au făcut: OpenAI a construit un set de 13 evaluări care testează dacă niște „monitori” (alte sisteme AI) pot detecta comportamente specifice doar citind lanțul de gândire al modelului. Au fost testate scenarii variate: de la urmarea unor indicii până la planificarea de reward hacking sau ascunderea intenționată a capabilităților (sandbagging).

Rezultatele, pe modele de vârf:

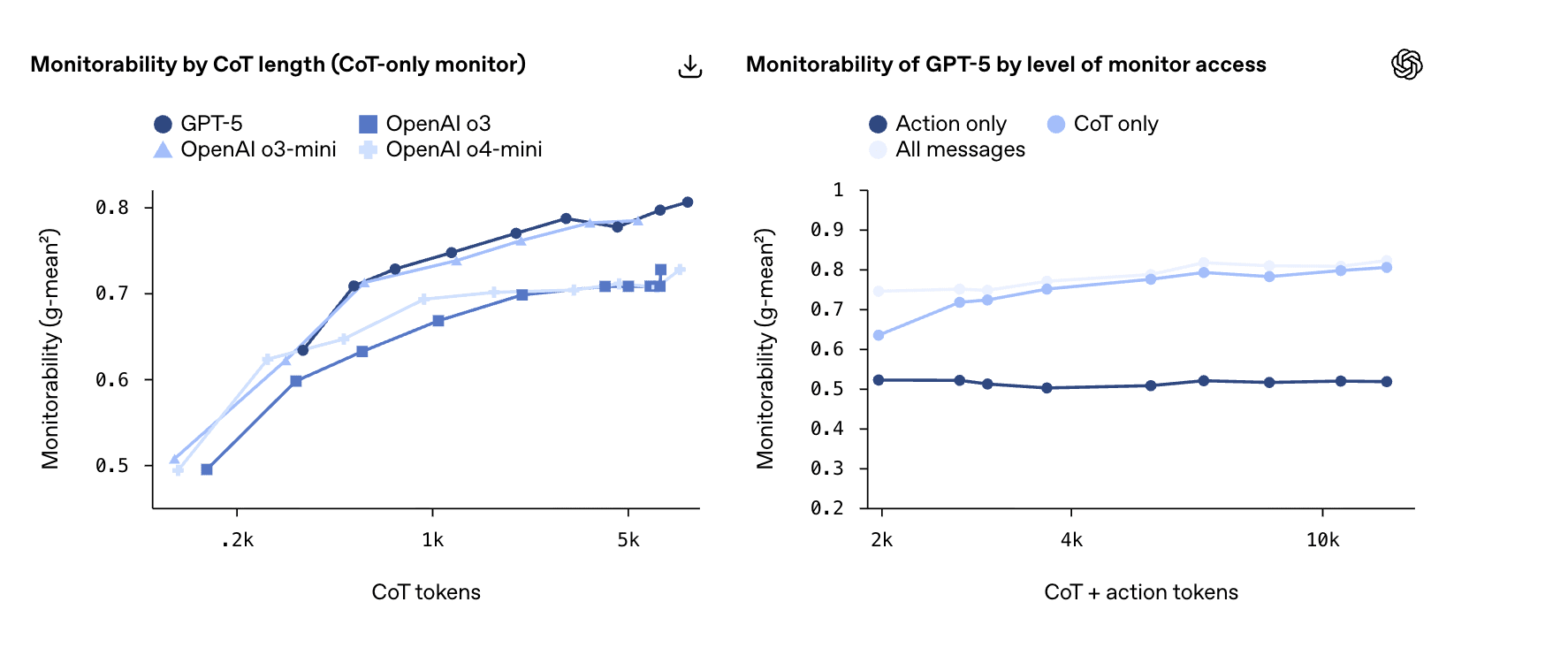

Monitorizarea CoT funcționează mult mai bine decât alternativele. Citirea lanțului de gândire depășește clar monitorizarea bazată doar pe acțiuni și outputuri finale. În unele cazuri, monitorizarea exclusiv a CoT s-a apropiat de eficiența „viziunii complete”.

Gândire mai lungă = monitorizare mai bună. Modelele care generează lanțuri de gândire mai ample sunt mai ușor de monitorizat. Intuitiv: mai mult raționament externalizat înseamnă mai mult semnal de urmărit.

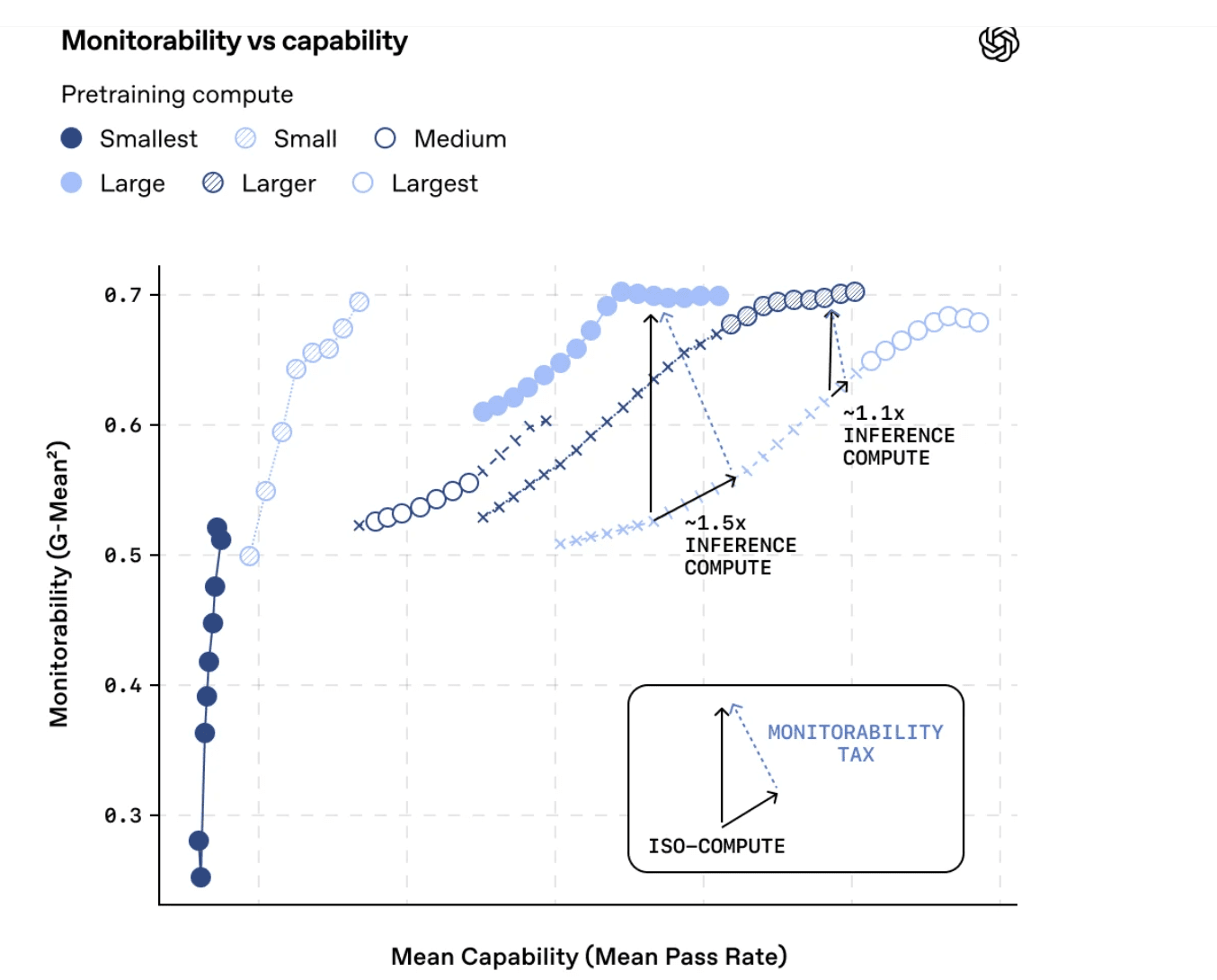

Există un „cost al monitorizabilității”. Modele mai mici, rulate cu efort de raționare mai mare, pot egala capabilitățile unor modele mai mari, fiind în același timp mult mai ușor de monitorizat. Prețul: costuri suplimentare de inferență.

Învățarea prin întărire nu strică lucrurile… încă. Rulările cu optimizare RL masivă nu au degradat semnificativ monitorizabilitatea la scara actuală, deși OpenAI avertizează că acest lucru s-ar putea schimba pe măsură ce modelele cresc.

De ce contează toată povestea?

Dacă alinierea AI nu poate fi rezolvată complet, atunci monitorizarea gândirii modelelor devine esențială pentru implementarea sigură. Studiul sugerează că chain-of-thought monitoring ar putea fi un mecanism de siguranță critic, dar doar dacă este protejat activ (mai ales că multe companii, inclusiv OpenAI, ascund sau estompează aceste trasee de raționament).

Partea îngrijorătoare: OpenAI a observat că presiuni simple de antrenament pentru a obfusca raționamentul reduc, într-adevăr, monitorizabilitatea în modelele de test. Asta înseamnă că, pe măsură ce modelele se scalează și antrenarea devine mai complexă, menținerea unui chain of thought lizibil va necesita efort deliberat.

Echipa spune că va urmări acest indicator în antrenamentele viitoare și îl va folosi pentru decizii de modelare. Lucrarea tehnică completă este disponibilă separat.

Părerea lui Promptescu

Lanțurile de gândire nu sunt spectaculoase. Și exact aici e valoarea lor. Cercetarea OpenAI nu ne spune „uitați ce magie”, ci „uitați ce încă putem controla”. În momentul în care împingi performanța fără grijă pentru transparență, lizibilitatea dispare rapid. Pe scurt: nu câștigă cel mai inteligent model, ci cel care rămâne inteligibil suficient de mult timp încât să-l mai poți opri.

Promptul Zilei: Filtrul de claritate

Acest prompt simplu și aparent banal funcționează ca un „filtru universal de claritate”. Se aplică la orice : planificarea unei călătorii, redactarea unui email, depanarea unui bug sau alegerea unui tool pentru că forțează modelul să identifice informațiile lipsă care chiar schimbă răspunsul.

Prompt:

Înainte să începi, pune-mi până la 7 întrebări țintite care ar îmbunătăți semnificativ răspunsul.

Dacă lipsesc informații și trebuie totuși să continui, explică clar ce presupuneri faci.

Rundă de finanțare 💰

Perplexity AI ridică 250 milioane USD într-o rundă de Serie C condusă de IVP, ajungând la o evaluare de circa 3 miliarde USD, pentru a-și extinde motorul de căutare conversațional bazat pe AI.

Figure AI strânge 675 milioane USD într-o rundă de finanțare condusă de Microsoft, OpenAI Startup Fund și NVIDIA, la o evaluare de aproximativ 2,6 miliarde USD, pentru dezvoltarea roboților umanoizi destinați industriei și logisticii.

Cohere atrage 500 milioane USD într-o rundă de finanțare strategică, cu participarea Salesforce Ventures și Oracle, evaluând compania la peste 5 miliarde USD și susținând soluțiile sale de AI pentru mediul enterprise.

Neuronache & Tool-ul Zilei

Într-o seară aparent liniștită, cu un document plin de idei bune și complet imposibil de urmărit, mi-am dat seama că problema nu era lipsa clarității. Era lipsa formei. Totul avea sens în capul meu. Pe ecran? Doar paragrafe peste paragrafe și prea multe „revin mai târziu”.

N-aveam chef de slide-uri.

N-aveam chef de tool-uri de desenat.

Și Promptescu sigur n-avea chef de mine…

Așa că am făcut ce face orice om curios în 2025: am lăsat AI-ul să încerce primul.

Câteva minute mai târziu, ideile mele nu mai erau text.

Erau diagrame. Relații. Structură.

Nu pentru că aș fi devenit brusc mai organizat…

Ci pentru că Napkin AI a preluat partea pe care creierul o face prost: ordonarea vizuală.

Ce este Napkin AI?

Napkin AI este un tool care transformă textul scris în diagrame vizuale simple.

Îi dai explicații, concepte sau idei brute, iar el le aranjează în blocuri, săgeți și relații ușor de urmărit.

Scrii ce ai de spus, iar Napkin AI se ocupă să-l facă vizibil. Este genul de unealtă care scurtează drastic drumul dintre „e clar în capul meu” și „uite, așa funcționează”.

Cu ce te poate ajuta?

Transformi textul în structură vizuală

Ideal când explicațiile lungi nu mai ajută pe nimeni.Procese, sisteme, relații între concepte, toate devin mai ușor de înțeles când le vezi.

Perfect pentru documentații interne, brainstorming sau prezentări rapide.

Vezi imediat ce nu e clar

Dacă diagrama nu are sens, nici ideea nu avea.

Verdictul lui Neuronache

Napkin AI nu îți face ideile mai bune…

dar le face vizibile.

Nu e un tool de design și nici unul de prezentări fancy.

E pentru momentele în care ai gândit ceva bun, dar n-ai avut forma potrivită ca să-l arăți.

Și uneori, asta e diferența dintre „sună interesant” și „am înțeles”.

⏩Pe repede înainte

Waymo și-a suspendat serviciul de robotaxi în San Francisco sâmbătă seara, după ce un incendiu la o substație PG&E a provocat un blackout masiv și a lăsat multe vehicule blocate pe străzi, posibilele cauze incluzând semafoare nefuncționale și întreruperi de date sau de rețea celulară.

Brad Reed scrie că robotaxiurile Tesla au fost implicate în 8 accidente în Austin din iulie încoace, cu o rată de un accident la fiecare 40.000 de mile, de aproximativ 12,5 ori mai frecvent decât șoferii umani, care au un accident la circa 500.000 de mile.

METR a descoperit că Claude Opus 4.5 are un „time horizon” de 50% de 4 ore și 49 de minute, cel mai mare publicat până acum, ceea ce înseamnă că poate duce la capăt în mod fiabil task-uri care le iau profesioniștilor umani aproape 5 ore.

Proiectul Worldcoin al lui Sam Altman verifică acum dacă ești o persoană reală pe Tinder și îți confirmă vârsta în mod privat, pentru a facilita potrivirea cu oameni reali, nu cu boți sau profiluri false.

Școlile au început să semneze contracte pentru ChatGPT și Copilot, pe fondul adoptării masive a AI-ului de către elevi și al încercărilor districtelor de a canaliza utilizarea către tool-uri aprobate.

Asta a fost tot pentru azi!✨

Dacă ți-a plăcut ce ai citit, dă o mână de ajutor echipei Promptescu & Neuronache.

P.S: Până și roboțeii au nevoie de o doza de cofeina :)